| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | ||

| 6 | 7 | 8 | 9 | 10 | 11 | 12 |

| 13 | 14 | 15 | 16 | 17 | 18 | 19 |

| 20 | 21 | 22 | 23 | 24 | 25 | 26 |

| 27 | 28 | 29 | 30 |

Tags

- 파이썬

- high level client

- plugin

- zip 파일 암호화

- Elasticsearch

- Mac

- Test

- License

- query

- springboot

- Java

- TensorFlow

- licence delete curl

- MySQL

- token filter test

- flask

- API

- 차트

- sort

- analyzer test

- aggregation

- Python

- Kafka

- docker

- matplotlib

- aggs

- ELASTIC

- zip 암호화

- 900gle

- license delete

Archives

- Today

- Total

개발잡부

[data] Parquet (파케이) 본문

반응형

파케이(Parquet)이란, 많은 양의 데이터를 처리하는데에 들어가는 시간과 비용을 절약하기 위해서 기존의 일반적인 행 기반(Row-based) 포맷이 아닌 열 기반(Column-based) 포맷의 처리를 말합니다.

파케이는 열 기반(Column-based) 포맷의 다른 종류인 ORC와 유사하지만, ORC는 Hive 최적화 / Parquet는 Apache 솔루션에 최적화 되어 있습니다.

테스트 해보자

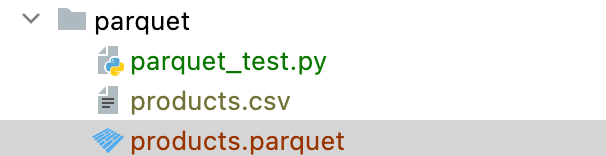

CSV를 Parquet 파일로 저장

products.csv

name

루이비통pyarrow 를 설치해보자

pip install pyarrowcsv 를 parquet 변환 생성

import pyarrow.parquet as pq

from pyarrow import csv

pq.write_table(csv.read_csv('products.csv'), 'products.parquet')

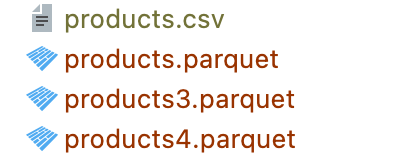

pandas

변환된 csv 파일을 pandas 함수로 parquet 파일을 데이터프레임으로 읽고 다시 데이터프레임을 parquet 로 저장

import pandas as pd

df = pd.read_parquet('products.parquet', engine='pyarrow')

df.to_parquet('products3.parquet', engine='pyarrow', index=False)

pyarrow

import pyarrow as pa

import pyarrow.parquet as pq

df = pq.read_pandas('products.parquet').to_pandas()

table_from_pandas = pa.Table.from_pandas(df, preserve_index=False)

pq.write_table(table_from_pandas, 'products4.parquet')

반응형

'Data' 카테고리의 다른 글

| [hadoop] hadoop install for mac os (0) | 2022.08.03 |

|---|---|

| [hadoop] hadoop 명령어 2 (0) | 2022.07.27 |

| [hadoop] mac OS 하둡설치 (0) | 2022.07.27 |

| [hadoop] Hadoop 명령어 (0) | 2022.07.27 |